Catégorie: Blogue

Avant d’examiner la manière dont l’intelligence artificielle (IA) et l’apprentissage automatique (AA) sont utilisés en cybersécurité, autant par des personnes bienveillantes que malveillantes, définissons l’IA et l’AA et voyons quelles en sont les capacités. Il est important de définir ces termes, car la plupart des gens les emploient sans distinction ou à tort pour décrire les utilisations de ces technologies.

Fondamentalement, les solutions de sécurité basées sur l’intelligence artificielle (IA) sont programmées pour identifier les comportements sûrs et malveillants. Pour ce faire, elles comparent les comportements et le trafic système des utilisateurs d’une entreprise ou d’un environnement donné à ceux d’un environnement similaire. En général, en matière de cybersécurité, l’IA est plus efficace lorsqu’on crée un cas de référence pour représenter le comportement de l’utilisateur; tout changement constaté par rapport au comportement de base déclenche une alerte auprès de la Sécurité informatique. Ce processus de surveillance des changements d’activité est souvent appelé « apprentissage non supervisé » : le système crée des modèles sans supervision humaine.

La valeur de l’IA réside dans le fait que, grâce à elle, les outils de cybersécurité sophistiqués sont capables d’analyser d’énormes ensembles de données, ce qui leur permet de développer des modèles d’activité pouvant détecter d’éventuels comportements malveillants et en alerter rapidement la Sécurité informatique. Avant l’arrivée des outils de sécurité de l’IA, comme vous le savez, une telle analyse était menée au prix d’un travail manuel pénible par les analystes des SOC qui, souvent, ne parvenaient à identifier les comportements anormaux qu’après une attaque réussie.

Ainsi, l’IA imite l’aptitude de ses contreparties humaines à détecter les menaces. Dans le domaine de la cybersécurité, l’IA est également utilisée pour l’automatisation, le triage, l’agrégation et la classification des alertes ainsi que pour l’automatisation des réponses, entre autres choses. En bref, l’IA est souvent utilisée pour renforcer le premier niveau de responsabilité des analystes des SOC, lequel consiste à enquêter sur les alertes et les événements.

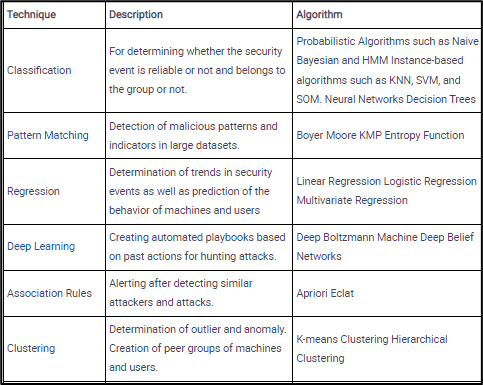

De même, l’apprentissage automatique (AA) détecte les menaces en surveillant continuellement le comportement du réseau à la recherche d’anomalies. Les moteurs d’apprentissage automatique traitent presque en temps réel d’énormes quantités de données pour trouver des incidents critiques. Ces techniques permettent de détecter les menaces internes, les logiciels malveillants inconnus et les violations de politiques.

L’apprentissage automatique peut prédire les sites Web malveillants en ligne afin d’empêcher que l’on s’y connecte. L’apprentissage automatique analyse l’activité sur internet pour identifier automatiquement les infrastructures d’attaque mises en place pour causer des violations de sécurité, qu’elles soient imminentes ou éventuelles.

Les algorithmes peuvent détecter les nouveaux fichiers et logiciels malveillants qui tentent de s’exécuter sur les systèmes de l’environnement. Ils identifient les nouvelles activités et fichiers malveillants en se basant sur les attributs et les comportements de logiciels malveillants qui n’ont jamais été vus et qui ne possèdent pas de signature.

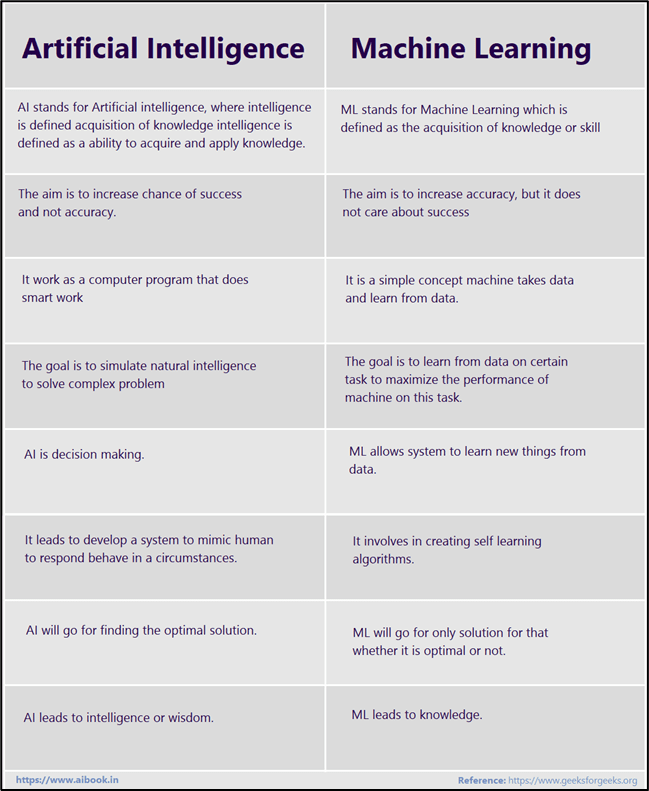

Comme nous l’avons évoqué précédemment, les termes « intelligence artificielle » (IA) et « apprentissage automatique » (AA) sont souvent utilisés indifféremment. Or, l’apprentissage automatique constitue un sous-ensemble de la catégorie plus vaste qu’est l’intelligence artificielle.

Ainsi, dans ce contexte, l’IA désigne la capacité générale des ordinateurs à imiter la pensée humaine et à s’acquitter de tâches humaines dans des environnements réels, tandis que l’apprentissage automatique désigne les technologies et les algorithmes qui permettent aux systèmes d’identifier des modèles, de prendre des décisions et de s’améliorer grâce à l’expérience et l’acquisition de données. Je le réitère ci-dessous en caractères gras parce que c’est important, et que, comme nous l’avons mentionné, la plupart des gens ne savent pas faire la différence entre ces deux termes.

L’IA désigne la capacité générale des ordinateurs à imiter la pensée humaine et à exécuter des tâches humaines dans des environnements du monde réel, tandis que l’AA désigne les technologies et les algorithmes qui permettent aux systèmes de repérer des modèles, de prendre des décisions et de s’améliorer grâce à l’expérience et aux données

Les développeurs de logiciels et les programmeurs informatiques permettent aux systèmes d’analyser les données et de produire une image juste du comportement de l’utilisateur et du système. En somme, ils créent des systèmes d’intelligence artificielle en utilisant des outils comme :

- l’apprentissage automatique;

- l’apprentissage profond;

- les réseaux neuronaux artificiels;

- la vision par ordinateur;

- le traitement du langage naturel.

Intelligence artificielle et apprentissage automatique en cybersécurité

L’intelligence artificielle (IA) devient de plus en plus puissante et facile à utiliser. De nombreuses technologies de cybersécurité intègrent l’IA et l’apprentissage automatique (AA) dans leurs produits. Comme nous l’avons mentionné, une foule d’entreprises ne disposent pas d’assez d’analystes SOC pour saisir, analyser et trier les données d’une cyberattaque et y répondre assez rapidement pour prévenir de futurs assauts.

Les entreprises utilisent désormais des outils d’IA et d’AA en sécurité informatique pour renforcer leurs défenses, tandis que les pirates utilisent ces mêmes outils pour percer les couches de protection de sécurité du client. Les attaques de rançongiciels et d’hameçonnage alimentées par l’IA sont désormais monnaie courante.

Nous sommes confrontés comme jamais à des attaques de plus en plus sophistiquées, mais plusieurs outils de cybersécurité basés sur l’IA ont vu le jour et connaissent un franc succès. Ces outils peuvent contribuer à nous rendre moins vulnérables aux brèches et à améliorer notre position globale en matière de cybersécurité.

Par exemple, l’AA peut protéger la productivité en analysant les activités suspectes de connexion aux applications nuagiques, en détectant les anomalies liées à la localisation et en effectuant des analyses de réputation d’adresse IP dans le but d’identifier les menaces et les risques associés aux applications et aux plateformes nuagiques. En outre, l’AA peut détecter les logiciels malveillants dans le trafic chiffré en analysant des éléments de données chiffrées du trafic dans la télémétrie du réseau commun. Au lieu de déchiffrer, les algorithmes d’apprentissage automatique repèrent plutôt les modèles malveillants pour révéler les menaces cachées par le chiffrement.

Les solutions de cybersécurité utilisant l’IA sont capables d’identifier et de prédire les menaces, d’y répondre et d’en tirer des enseignements, sans dépendre de l’intervention humaine. Les outils de sécurité basés sur l’IA peuvent ainsi :

- apprendre de manière autonome à partir de comportements précédemment détectés;

- contextualiser des informations ou des comportements nouveaux ou incomplets et en tirer des conclusions;

- présenter des stratégies viables de remédiation des menaces ou des failles de sécurité.

Terminons cette section en essayant une fois de plus de définir clairement l’intelligence artificielle et l’apprentissage automatique. Nous ajouterons même un autre terme, l’« apprentissage profond », qui accompagne souvent les deux autres.

L’intelligence artificielle est le domaine du développement d’ordinateurs et de robots capables d’imiter les comportements humains tout en dépassant nos capacités. Les programmes basés sur l’IA peuvent analyser et contextualiser des données pour fournir des informations ou déclencher automatiquement des actions sans qu’il y ait intervention humaine.

L’apprentissage automatique est une voie d’accès à l’intelligence artificielle. Cette sous-catégorie de l’IA utilise des algorithmes pour apprendre automatiquement et repérer des modèles dans les données, en appliquant cet apprentissage à la prise de décisions toujours plus judicieuses.

En étudiant l’apprentissage automatique et en menant des expériences, les programmeurs testent les limites de ce qu’il est possible de faire pour améliorer la perception, la cognition et l’action d’un système informatique.

L’apprentissage profond, une méthode avancée d’apprentissage automatique, va encore plus loin. Les modèles d’apprentissage profond utilisent de vastes réseaux neuronaux artificiels (des réseaux qui fonctionnent comme un cerveau humain pour analyser logiquement les données) afin d’apprendre des modèles complexes et de faire des prédictions sans intervention humaine.

Nouvelle surface d’attaque ouverte par la transformation numérique

Comme nous l’avons avancé dans notre série de blogues en 4 parties sur la transformation numérique, cette transformation se produit si rapidement que ce n’est souvent qu’après-coup que l’on réfléchit à la sécurité informatique. Les stratégies de transformation numérique ont créé de nouvelles surfaces d’attaque obligeant les équipes SecOps et IR à se munir de nouvelles capacités de contrôle adaptatif. En outre, la transformation des modèles d’affaires change tout, de la façon dont nous gérons notre vie quotidienne à la façon dont nous dirigeons les entreprises.

La transformation numérique est le processus par lequel les entreprises intègrent des technologies dans leurs activités afin d’amener des changements fondamentaux

Les consommateurs s’attendent désormais à obtenir ce qu’ils veulent presque instantanément, parce que les fournisseurs de services disposent de la technologie pour le leur fournir. L’augmentation des attaques de logiciels malveillants et autres force les entreprises à poursuivre leur stratégie de transformation, sous peine de se laisser distancer par la concurrence.

« Favoriser les initiatives de transformation numérique et un modèle de télétravail entraîne une hausse vertigineuse du nombre de points exposés dans les réseaux », explique Bob Turner, responsable de la sécurité des informations sur le terrain pour l’enseignement supérieur chez Fortinet. En même temps, les logiciels malveillants, rançongiciels et autres menaces continuent de défier les entreprises en exploitant les failles de dispositifs d’extrémité qui ne bénéficient pas d’une protection cohérente. »

Pourquoi recueillir autant de données?

Pour être utiles en cybersécurité, l’intelligence artificielle et l’apprentissage automatique requièrent d’énormes quantités de données. Traiter toutes ces données tout en alimentant en contenu les classificateurs d’apprentissage automatique est l’un des nombreux objectifs à atteindre pour faire de l’IA un élément essentiel aux yeux des entreprises.

Sans mégadonnées, l’IA et l’AA ont peu de valeur en cybersécurité. Les attaques sophistiquées génèrent une multitude de données. Si la configuration d’un moteur d’IA et d’AA n’est pas optimale, le système produira davantage de faux positifs pour l’équipe SecOps.

Fixer des objectifs pour l’IA et l’AA pour les équipes SecOps et DevOps

Les entreprises doivent nécessairement comprendre la raison d’être et le but de l’IA et de l’AA pour les opérations de sécurité. L’échec d’une entreprise à tirer le meilleur parti des capacités de l’IA conduira à des investissements non développés et non uniformisés. Pour profiter au maximum de la plateforme, les entreprises qui choisissent d’investir dans l’IA et l’AA doivent, en plus du coût initial, investir continuellement dans la technologie et l’expertise du capital humain.

Acceptation du risque lié à l’exploitation de l’IA et de l’AA en cybersécurité

Les entreprises qui font d’importants investissements en IA et en AA doivent, en toute connaissance de cause, accepter le risque qu’elles introduisent. Les outils de sécurité alimentés à l’IA utilisés pour traiter les données et analyser les meilleures façons de réaliser des processus rudimentaires sont en plein essor; l’IA présente par ailleurs un risque inhérent de manipulation des processus. Comme tous les systèmes, ceux d’intelligence artificielle sont susceptibles d’être attaqués.

Comprendre les attaques d’apprentissage automatique adversariales

Les attaques adversariales exploitent la puissance de l’IA pour menacer avec persistance les réseaux d’entreprise. À l’image des entreprises qui, pour mieux prédire la prochaine cyberattaque, investissent dans des moyens de transformer les flux de données en ensembles de données d’utilisation pour les classificateurs d’apprentissage automatique, les pirates utilisent eux aussi l’IA et l’AA, pour déterminer le moyen le plus efficace de frapper leurs cibles.

Les systèmes d’apprentissage automatique se distinguent des programmes informatiques conventionnels en ce qu’ils n’ont plus besoin d’être mis à jour une fois installés. Ils sont donc vulnérables aux attaques, même sans être connectés à l’internet. Et contrairement aux failles de sécurité habituelles, qui nécessitent généralement un accès physique à l’appareil, les faiblesses de l’apprentissage automatique peuvent exister sans la moindre connexion avec le monde extérieur.

Un exemple concret : des algorithmes d’AA peuvent servir à analyser le trafic réseau pour détecter les attaques basées sur le réseau, telles que les attaques DDoS. Par exemple, un algorithme entraîné peut détecter le fort volume de trafic d’un serveur pendant une attaque DDoS. Par exemple, un algorithme entraîné peut détecter le fort volume de trafic d’un serveur pendant une attaque DDoS. En outre, les algorithmes peuvent également découvrir le vecteur ou le type d’attaque, comme TCP Flood, ce qui permet aux équipes des SOC de prendre certaines précautions face aux nouvelles cybermenaces.

Un autre exemple concret : les solutions basées sur l’AA peuvent être entraînées à détecter des anomalies dans les requêtes HTTP et à lancer des alertes en cas d’attaque. On peut également les entraîner à classer les types d’attaques (injection SQL, attaque XSS) et à détecter les vecteurs d’attaque.

Risque de manipulation des flux de données pour l’IA et l’AA

L’IA et l’AA deviennent de plus en plus essentiels pour la cybersécurité, car ces technologies apprennent tout au long de leur vie à reconnaître de nouveaux types de menaces. Elles s’appuient sur les historiques de comportement des utilisateurs pour créer des profils d’individus, d’entreprises et de systèmes, ce qui leur permet de repérer les écarts par rapport aux normes établies.

Les outils de sécurité conventionnels utilisent des signatures ou des indicateurs de compromission (IOC) pour identifier les menaces. Cette technique permet d’identifier facilement les menaces déjà connues. Cependant, les outils basés sur les signatures sont incapables de détecter les menaces qui n’ont pas encore été découvertes. En réalité, ils ne peuvent identifier qu’environ 90 % des menaces.

L’intelligence artificielle peut accroître le taux de détection des techniques conventionnelles jusqu’à 95 %. Le problème, c’est que l’on risque d’obtenir de nombreux faux positifs. Aussi la meilleure option consiste-t-elle à combiner l’IA et les méthodes conventionnelles. Cette fusion entre le conventionnel et l’innovant permet d’obtenir un taux de détection pouvant atteindre 100 %, réduisant ainsi au minimum les faux positifs.

En outre, comme le découvrent de plus en plus d’entreprises dans le cadre de leurs activités de réponse aux incidents, notamment lors de la phase des leçons apprises, les atteintes à la cybersécurité (et tout particulièrement les déviations précoces) surviennent six mois à un an avant l’attaque. On retrouve ces « miettes » dans les fichiers journaux ou les alertes SNMP envoyées directement au SIEM. Une déviation trouvée avec le système de prévention de la perte de données du CASB, ainsi qu’un détail supplémentaire trouvé aujourd’hui dans la solution de sécurité des points de terminaison, est maintenant corrélée avec les systèmes de détection et de réponse étendus (XDR) . En capturant la télémétrie de plusieurs hôtes et contrôles adaptatifs, les XDR, grâce à la puissance de l’AA, peuvent autocorréler ces événements dans un rapport de chaîne d’élimination ou s’aligner sur le cadre d’attaque MITRE pour accéder à des capacités supplémentaires de chasse aux menaces et de réponse aux incidents.

Grâce aux capacités des systèmes XDR, les entreprises peuvent tirer parti de la puissance de l’IA et de l’AA. Mais, et si les miettes n’étaient qu’une ruse? Et si les miettes laissées par les pirates cachaient une attaque sous faux pavillon, ne visant qu’à manipuler le classificateur AA et la réponse automatique?

Les entreprises qui réfléchissent à la valeur de l’IA et de l’AA doivent donc impérativement prendre conscience de cette réalité. La manipulation des données par les pirates commence parfois des mois, voire une année, avant l’attaque. Le pirate tâte le terrain en semant des miettes pour évaluer la méthode et la réponse des capacités d’AA ou de (SOAR) (« sécurité, orchestration, automatisation et réponse »).

Après la première cyberattaque, combien de temps a-t-il fallu à l’entreprise pour reconnaître, identifier et éradiquer la menace, puis pour restaurer le système? Les pirates qui sondent et testent les capacités d’AA du client poursuivent leur reconnaissance jusqu’au mois précédant l’attaque.

Conclusion

Au cours des dernières années, l’intelligence artificielle (IA) s’est imposée comme un outil essentiel permettant d’accroître les efforts déployés par les professionnels humains de la sécurité informatique. À l’être humain incapable de protéger adéquatement par lui-même la surface d’attaque grandissante de l’entreprise moderne, l’IA offre des capacités d’analyse et de détection indispensables que les professionnels de la cybersécurité peuvent utiliser pour réduire les risques et améliorer la posture de sécurité.

La gestion des systèmes d’IA n’est pas à l’abri de l’erreur humaine. De manière générale, les applications d’apprentissage automatique et les outils d’IA sont confrontés à de nombreuses menaces. Pour les entreprises, il est primordial de disposer d’ensembles de données précis pour profiter pleinement de la valeur de l’IA et de l’AA pour la cybersécurité et les opérations commerciales.

L’IA et l’AA peuvent offrir une protection renforcée sans augmenter le personnel ni grever le budget de la plupart des entreprises. L’apprentissage automatique est une technologie de pointe, et elle n’est pas bon marché. Or, chaque dollar investi dans les capacités de réponse préventive d’une entreprise équivaut à cinq ou six dollars dépensés pour réagir à une attaque. Il est assurément plus coûteux de lutter contre un incendie que d’acheter un extincteur, j’ai entendu cette analogie lors d’une cyberconférence récemment, et je l’ai trouvée excellente.

Pour réussir, et cela s’applique à presque tous les secteurs, les entreprises doivent être en mesure de transformer leurs données en informations exploitables. L’intelligence artificielle et l’apprentissage automatique offrent aux entreprises l’avantage d’automatiser une variété de processus manuels impliquant des données et des prises de décisions.

En intégrant l’intelligence artificielle et l’apprentissage automatique à leurs systèmes et à leurs plans stratégiques, les dirigeants peuvent comprendre les informations tirées des données et y réagir beaucoup plus rapidement et efficacement.